Top Related Projects

The most comprehensive database of Chinese poetry 🧶最全中华古诗词数据库, 唐宋两朝近一万四千古诗人, 接近5.5万首唐诗加26万宋诗. 两宋时期1564位词人,21050首词。

中文自然语言处理数据集,平时做做实验的材料。欢迎补充提交合并。

中英文敏感词、语言检测、中外手机/电话归属地/运营商查询、名字推断性别、手机号抽取、身份证抽取、邮箱抽取、中日文人名库、中文缩写库、拆字词典、词汇情感值、停用词、反动词表、暴恐词表、繁简体转换、英文模拟中文发音、汪峰歌词生成器、职业名称词库、同义词库、反义词库、否定词库、汽车品牌词库、汽车零件词库、连续英文切割、各种中文词向量、公司名字大全、古诗词库、IT词库、财经词库、成语词库、地名词库、历史名人词库、诗词词库、医学词库、饮食词库、法律词库、汽车词库、动物词库、中文聊天语料、中文谣言数据、百度中文问答数据集、句子相似度匹配算法集合、bert资源、文本生成&摘要相关工具、cocoNLP信息抽取工具、国内电话号码正则匹配、清华大学XLORE:中英文跨语言百科知识图谱、清华大学人工智能技术系列报告、自然语言生成、NLU太难了系列、自动对联数据及机器人、用户名黑名单列表、罪名法务名词及分类模型、微信公众号语料、cs224n深度学习自然语言处理课程、中文手写汉字识别、中文自然语言处理 语料/数据集、变量命名神器、分词语料库+代码、任务型对话英文数据集、ASR 语音数据集 + 基于深度学习的中文语音识别系统、笑声检测器、Microsoft多语言数字/单位/如日期时间识别包、中华新华字典数据库及api(包括常用歇后语、成语、词语和汉字)、文档图谱自动生成、SpaCy 中文模型、Common Voice语音识别数据集新版、神经网络关系抽取、基于bert的命名实体识别、关键词(Keyphrase)抽取包pke、基于医疗领域知识图谱的问答系统、基于依存句法与语义角色标注的事件三元组抽取、依存句法分析4万句高质量标注数据、cnocr:用来做中文OCR的Python3包、中文人物关系知识图谱项目、中文nlp竞赛项目及代码汇总、中文字符数据、speech-aligner: 从“人声语音”及其“语言文本”产生音素级别时间对齐标注的工具、AmpliGraph: 知识图谱表示学习(Python)库:知识图谱概念链接预测、Scattertext 文本可视化(python)、语言/知识表示工具:BERT & ERNIE、中文对比英文自然语言处理NLP的区别综述、Synonyms中文近义词工具包、HarvestText领域自适应文本挖掘工具(新词发现-情感分析-实体链接等)、word2word:(Python)方便易用的多语言词-词对集:62种语言/3,564个多语言对、语音识别语料生成工具:从具有音频/字幕的在线视频创建自动语音识别(ASR)语料库、构建医疗实体识别的模型(包含词典和语料标注)、单文档非监督的关键词抽取、Kashgari中使用gpt-2语言模型、开源的金融投资数据提取工具、文本自动摘要库TextTeaser: 仅支持英文、人民日报语料处理工具集、一些关于自然语言的基本模型、基于14W歌曲知识库的问答尝试--功能包括歌词接龙and已知歌词找歌曲以及歌曲歌手歌词三角关系的问答、基于Siamese bilstm模型的相似句子判定模型并提供训练数据集和测试数据集、用Transformer编解码模型实现的根据Hacker News文章标题自动生成评论、用BERT进行序列标记和文本分类的模板代码、LitBank:NLP数据集——支持自然语言处理和计算人文学科任务的100部带标记英文小说语料、百度开源的基准信息抽取系统、虚假新闻数据集、Facebook: LAMA语言模型分析,提供Transformer-XL/BERT/ELMo/GPT预训练语言模型的统一访问接口、CommonsenseQA:面向常识的英文QA挑战、中文知识图谱资料、数据及工具、各大公司内部里大牛分享的技术文档 PDF 或者 PPT、自然语言生成SQL语句(英文)、中文NLP数据增强(EDA)工具、英文NLP数据增强工具 、基于医药知识图谱的智能问答系统、京东商品知识图谱、基于mongodb存储的军事领域知识图谱问答项目、基于远监督的中文关系抽取、语音情感分析、中文ULMFiT-情感分析-文本分类-语料及模型、一个拍照做题程序、世界各国大规模人名库、一个利用有趣中文语料库 qingyun 训练出来的中文聊天机器人、中文聊天机器人seqGAN、省市区镇行政区划数据带拼音标注、教育行业新闻语料库包含自动文摘功能、开放了对话机器人-知识图谱-语义理解-自然语言处理工具及数据、中文知识图谱:基于百度百科中文页面-抽取三元组信息-构建中文知识图谱、masr: 中文语音识别-提供预训练模型-高识别率、Python音频数据增广库、中文全词覆盖BERT及两份阅读理解数据、ConvLab:开源多域端到端对话系统平台、中文自然语言处理数据集、基于最新版本rasa搭建的对话系统、基于TensorFlow和BERT的管道式实体及关系抽取、一个小型的证券知识图谱/知识库、复盘所有NLP比赛的TOP方案、OpenCLaP:多领域开源中文预训练语言模型仓库、UER:基于不同语料+编码器+目标任务的中文预训练模型仓库、中文自然语言处理向量合集、基于金融-司法领域(兼有闲聊性质)的聊天机器人、g2pC:基于上下文的汉语读音自动标记模块、Zincbase 知识图谱构建工具包、诗歌质量评价/细粒度情感诗歌语料库、快速转化「中文数字」和「阿拉伯数字」、百度知道问答语料库、基于知识图谱的问答系统、jieba_fast 加速版的jieba、正则表达式教程、中文阅读理解数据集、基于BERT等最新语言模型的抽取式摘要提取、Python利用深度学习进行文本摘要的综合指南、知识图谱深度学习相关资料整理、维基大规模平行文本语料、StanfordNLP 0.2.0:纯Python版自然语言处理包、NeuralNLP-NeuralClassifier:腾讯开源深度学习文本分类工具、端到端的封闭域对话系统、中文命名实体识别:NeuroNER vs. BertNER、新闻事件线索抽取、2019年百度的三元组抽取比赛:“科学空间队”源码、基于依存句法的开放域文本知识三元组抽取和知识库构建、中文的GPT2训练代码、ML-NLP - 机器学习(Machine Learning)NLP面试中常考到的知识点和代码实现、nlp4han:中文自然语言处理工具集(断句/分词/词性标注/组块/句法分析/语义分析/NER/N元语法/HMM/代词消解/情感分析/拼写检查、XLM:Facebook的跨语言预训练语言模型、用基于BERT的微调和特征提取方法来进行知识图谱百度百科人物词条属性抽取、中文自然语言处理相关的开放任务-数据集-当前最佳结果、CoupletAI - 基于CNN+Bi-LSTM+Attention 的自动对对联系统、抽象知识图谱、MiningZhiDaoQACorpus - 580万百度知道问答数据挖掘项目、brat rapid annotation tool: 序列标注工具、大规模中文知识图谱数据:1.4亿实体、数据增强在机器翻译及其他nlp任务中的应用及效果、allennlp阅读理解:支持多种数据和模型、PDF表格数据提取工具 、 Graphbrain:AI开源软件库和科研工具,目的是促进自动意义提取和文本理解以及知识的探索和推断、简历自动筛选系统、基于命名实体识别的简历自动摘要、中文语言理解测评基准,包括代表性的数据集&基准模型&语料库&排行榜、树洞 OCR 文字识别 、从包含表格的扫描图片中识别表格和文字、语声迁移、Python口语自然语言处理工具集(英文)、 similarity:相似度计算工具包,java编写、海量中文预训练ALBERT模型 、Transformers 2.0 、基于大规模音频数据集Audioset的音频增强 、Poplar:网页版自然语言标注工具、图片文字去除,可用于漫画翻译 、186种语言的数字叫法库、Amazon发布基于知识的人-人开放领域对话数据集 、中文文本纠错模块代码、繁简体转换 、 Python实现的多种文本可读性评价指标、类似于人名/地名/组织机构名的命名体识别数据集 、东南大学《知识图谱》研究生课程(资料)、. 英文拼写检查库 、 wwsearch是企业微信后台自研的全文检索引擎、CHAMELEON:深度学习新闻推荐系统元架构 、 8篇论文梳理BERT相关模型进展与反思、DocSearch:免费文档搜索引擎、 LIDA:轻量交互式对话标注工具 、aili - the fastest in-memory index in the East 东半球最快并发索引 、知识图谱车音工作项目、自然语言生成资源大全 、中日韩分词库mecab的Python接口库、中文文本摘要/关键词提取、汉字字符特征提取器 (featurizer),提取汉字的特征(发音特征、字形特征)用做深度学习的特征、中文生成任务基准测评 、中文缩写数据集、中文任务基准测评 - 代表性的数据集-基准(预训练)模型-语料库-baseline-工具包-排行榜、PySS3:面向可解释AI的SS3文本分类器机器可视化工具 、中文NLP数据集列表、COPE - 格律诗编辑程序、doccano:基于网页的开源协同多语言文本标注工具 、PreNLP:自然语言预处理库、简单的简历解析器,用来从简历中提取关键信息、用于中文闲聊的GPT2模型:GPT2-chitchat、基于检索聊天机器人多轮响应选择相关资源列表(Leaderboards、Datasets、Papers)、(Colab)抽象文本摘要实现集锦(教程 、词语拼音数据、高效模糊搜索工具、NLP数据增广资源集、微软对话机器人框架 、 GitHub Typo Corpus:大规模GitHub多语言拼写错误/语法错误数据集、TextCluster:短文本聚类预处理模块 Short text cluster、面向语音识别的中文文本规范化、BLINK:最先进的实体链接库、BertPunc:基于BERT的最先进标点修复模型、Tokenizer:快速、可定制的文本词条化库、中文语言理解测评基准,包括代表性的数据集、基准(预训练)模型、语料库、排行榜、spaCy 医学文本挖掘与信息提取 、 NLP任务示例项目代码集、 python拼写检查库、chatbot-list - 行业内关于智能客服、聊天机器人的应用和架构、算法分享和介绍、语音质量评价指标(MOSNet, BSSEval, STOI, PESQ, SRMR)、 用138GB语料训练的法文RoBERTa预训练语言模型 、BERT-NER-Pytorch:三种不同模式的BERT中文NER实验、无道词典 - 有道词典的命令行版本,支持英汉互查和在线查询、2019年NLP亮点回顾、 Chinese medical dialogue data 中文医疗对话数据集 、最好的汉字数字(中文数字)-阿拉伯数字转换工具、 基于百科知识库的中文词语多词义/义项获取与特定句子词语语义消歧、awesome-nlp-sentiment-analysis - 情感分析、情绪原因识别、评价对象和评价词抽取、LineFlow:面向所有深度学习框架的NLP数据高效加载器、中文医学NLP公开资源整理 、MedQuAD:(英文)医学问答数据集、将自然语言数字串解析转换为整数和浮点数、Transfer Learning in Natural Language Processing (NLP) 、面向语音识别的中文/英文发音辞典、Tokenizers:注重性能与多功能性的最先进分词器、CLUENER 细粒度命名实体识别 Fine Grained Named Entity Recognition、 基于BERT的中文命名实体识别、中文谣言数据库、NLP数据集/基准任务大列表、nlp相关的一些论文及代码, 包括主题模型、词向量(Word Embedding)、命名实体识别(NER)、文本分类(Text Classificatin)、文本生成(Text Generation)、文本相似性(Text Similarity)计算等,涉及到各种与nlp相关的算法,基于keras和tensorflow 、Python文本挖掘/NLP实战示例、 Blackstone:面向非结构化法律文本的spaCy pipeline和NLP模型通过同义词替换实现文本“变脸” 、中文 预训练 ELECTREA 模型: 基于对抗学习 pretrain Chinese Model 、albert-chinese-ner - 用预训练语言模型ALBERT做中文NER 、基于GPT2的特定主题文本生成/文本增广、开源预训练语言模型合集、多语言句向量包、编码、标记和实现:一种可控高效的文本生成方法、 英文脏话大列表 、attnvis:GPT2、BERT等transformer语言模型注意力交互可视化、CoVoST:Facebook发布的多语种语音-文本翻译语料库,包括11种语言(法语、德语、荷兰语、俄语、西班牙语、意大利语、土耳其语、波斯语、瑞典语、蒙古语和中文)的语音、文字转录及英文译文、Jiagu自然语言处理工具 - 以BiLSTM等模型为基础,提供知识图谱关系抽取 中文分词 词性标注 命名实体识别 情感分析 新词发现 关键词 文本摘要 文本聚类等功能、用unet实现对文档表格的自动检测,表格重建、NLP事件提取文献资源列表 、 金融领域自然语言处理研究资源大列表、CLUEDatasetSearch - 中英文NLP数据集:搜索所有中文NLP数据集,附常用英文NLP数据集 、medical_NER - 中文医学知识图谱命名实体识别 、(哈佛)讲因果推理的免费书、知识图谱相关学习资料/数据集/工具资源大列表、Forte:灵活强大的自然语言处理pipeline工具集 、Python字符串相似性算法库、PyLaia:面向手写文档分析的深度学习工具包、TextFooler:针对文本分类/推理的对抗文本生成模块、Haystack:灵活、强大的可扩展问答(QA)框架、中文关键短语抽取工具

搜集、整理、发布 中文 自然语言处理 语料/数据集,与 有志之士 共同 促进 中文 自然语言处理 的 发展。

:herb: 中文近义词:聊天机器人,智能问答工具包

Quick Overview

The brightmart/nlp_chinese_corpus repository is a collection of large-scale Chinese text datasets for natural language processing tasks. It provides various corpora for different NLP applications, including sentiment analysis, text classification, and language modeling. The datasets are curated from diverse sources and are intended to support research and development in Chinese NLP.

Pros

- Offers a wide range of Chinese text datasets for different NLP tasks

- Large-scale corpora, suitable for training deep learning models

- Well-organized and easily accessible datasets

- Includes both general and domain-specific text collections

Cons

- Limited documentation on data collection and preprocessing methods

- Some datasets may lack detailed annotations or metadata

- Potential bias in certain datasets due to source selection

- May require significant computational resources to process and utilize the larger datasets

Getting Started

As this is not a code library but a collection of datasets, there is no code-specific getting started guide. However, to use these datasets:

-

Clone the repository:

git clone https://github.com/brightmart/nlp_chinese_corpus.git -

Navigate to the desired dataset folder.

-

Download the dataset files (usually in .txt or .json format).

-

Use your preferred NLP tools or libraries to load and process the data for your specific task.

-

Refer to the README.md file in each dataset folder for specific information about the data format and contents.

Competitor Comparisons

The most comprehensive database of Chinese poetry 🧶最全中华古诗词数据库, 唐宋两朝近一万四千古诗人, 接近5.5万首唐诗加26万宋诗. 两宋时期1564位词人,21050首词。

Pros of chinese-poetry

- Focused specifically on classical Chinese poetry, providing a comprehensive collection

- Includes metadata like author information and poem categories

- Offers tools for working with the poetry data, such as rhyme analysis

Cons of chinese-poetry

- Limited to poetry, not as diverse in content types as nlp_chinese_corpus

- May require more preprocessing for general NLP tasks

- Less suitable for modern Chinese language processing

Code Comparison

nlp_chinese_corpus:

import json

with open('webtext2019zh/web_text_zh_train.json', 'r') as f:

data = json.load(f)

for item in data:

print(item['title'], item['content'])

chinese-poetry:

import json

with open('json/poet.tang.0.json', 'r', encoding='utf-8') as f:

poems = json.load(f)

for poem in poems:

print(poem['author'], poem['title'], poem['paragraphs'])

Summary

nlp_chinese_corpus offers a broader range of Chinese text data suitable for various NLP tasks, including modern Chinese processing. It contains diverse content types such as news articles, social media posts, and conversations.

chinese-poetry specializes in classical Chinese poetry, providing a deep but narrow dataset. It's ideal for tasks related to traditional Chinese literature and poetry analysis but may be less versatile for general NLP applications.

Both repositories provide valuable resources for Chinese language processing, with nlp_chinese_corpus being more general-purpose and chinese-poetry offering specialized poetic content.

中文自然语言处理数据集,平时做做实验的材料。欢迎补充提交合并。

Pros of ChineseNLPCorpus

- More diverse range of NLP tasks covered, including sentiment analysis, text classification, and named entity recognition

- Better organized structure with clear categorization of datasets

- More recent updates and active maintenance

Cons of ChineseNLPCorpus

- Smaller overall corpus size compared to nlp_chinese_corpus

- Less focus on large-scale pre-training datasets

- Some datasets require additional processing or formatting

Code Comparison

nlp_chinese_corpus:

import json

with open('news_chinese_corpus.json', 'r', encoding='utf-8') as f:

data = json.load(f)

for item in data:

print(item['title'], item['content'])

ChineseNLPCorpus:

import pandas as pd

df = pd.read_csv('weibo_senti_100k.csv')

for index, row in df.iterrows():

print(row['label'], row['review'])

The code snippets demonstrate the different data formats and access methods used in each repository. nlp_chinese_corpus typically uses JSON files, while ChineseNLPCorpus often employs CSV formats, requiring different parsing approaches.

中英文敏感词、语言检测、中外手机/电话归属地/运营商查询、名字推断性别、手机号抽取、身份证抽取、邮箱抽取、中日文人名库、中文缩写库、拆字词典、词汇情感值、停用词、反动词表、暴恐词表、繁简体转换、英文模拟中文发音、汪峰歌词生成器、职业名称词库、同义词库、反义词库、否定词库、汽车品牌词库、汽车零件词库、连续英文切割、各种中文词向量、公司名字大全、古诗词库、IT词库、财经词库、成语词库、地名词库、历史名人词库、诗词词库、医学词库、饮食词库、法律词库、汽车词库、动物词库、中文聊天语料、中文谣言数据、百度中文问答数据集、句子相似度匹配算法集合、bert资源、文本生成&摘要相关工具、cocoNLP信息抽取工具、国内电话号码正则匹配、清华大学XLORE:中英文跨语言百科知识图谱、清华大学人工智能技术系列报告、自然语言生成、NLU太难了系列、自动对联数据及机器人、用户名黑名单列表、罪名法务名词及分类模型、微信公众号语料、cs224n深度学习自然语言处理课程、中文手写汉字识别、中文自然语言处理 语料/数据集、变量命名神器、分词语料库+代码、任务型对话英文数据集、ASR 语音数据集 + 基于深度学习的中文语音识别系统、笑声检测器、Microsoft多语言数字/单位/如日期时间识别包、中华新华字典数据库及api(包括常用歇后语、成语、词语和汉字)、文档图谱自动生成、SpaCy 中文模型、Common Voice语音识别数据集新版、神经网络关系抽取、基于bert的命名实体识别、关键词(Keyphrase)抽取包pke、基于医疗领域知识图谱的问答系统、基于依存句法与语义角色标注的事件三元组抽取、依存句法分析4万句高质量标注数据、cnocr:用来做中文OCR的Python3包、中文人物关系知识图谱项目、中文nlp竞赛项目及代码汇总、中文字符数据、speech-aligner: 从“人声语音”及其“语言文本”产生音素级别时间对齐标注的工具、AmpliGraph: 知识图谱表示学习(Python)库:知识图谱概念链接预测、Scattertext 文本可视化(python)、语言/知识表示工具:BERT & ERNIE、中文对比英文自然语言处理NLP的区别综述、Synonyms中文近义词工具包、HarvestText领域自适应文本挖掘工具(新词发现-情感分析-实体链接等)、word2word:(Python)方便易用的多语言词-词对集:62种语言/3,564个多语言对、语音识别语料生成工具:从具有音频/字幕的在线视频创建自动语音识别(ASR)语料库、构建医疗实体识别的模型(包含词典和语料标注)、单文档非监督的关键词抽取、Kashgari中使用gpt-2语言模型、开源的金融投资数据提取工具、文本自动摘要库TextTeaser: 仅支持英文、人民日报语料处理工具集、一些关于自然语言的基本模型、基于14W歌曲知识库的问答尝试--功能包括歌词接龙and已知歌词找歌曲以及歌曲歌手歌词三角关系的问答、基于Siamese bilstm模型的相似句子判定模型并提供训练数据集和测试数据集、用Transformer编解码模型实现的根据Hacker News文章标题自动生成评论、用BERT进行序列标记和文本分类的模板代码、LitBank:NLP数据集——支持自然语言处理和计算人文学科任务的100部带标记英文小说语料、百度开源的基准信息抽取系统、虚假新闻数据集、Facebook: LAMA语言模型分析,提供Transformer-XL/BERT/ELMo/GPT预训练语言模型的统一访问接口、CommonsenseQA:面向常识的英文QA挑战、中文知识图谱资料、数据及工具、各大公司内部里大牛分享的技术文档 PDF 或者 PPT、自然语言生成SQL语句(英文)、中文NLP数据增强(EDA)工具、英文NLP数据增强工具 、基于医药知识图谱的智能问答系统、京东商品知识图谱、基于mongodb存储的军事领域知识图谱问答项目、基于远监督的中文关系抽取、语音情感分析、中文ULMFiT-情感分析-文本分类-语料及模型、一个拍照做题程序、世界各国大规模人名库、一个利用有趣中文语料库 qingyun 训练出来的中文聊天机器人、中文聊天机器人seqGAN、省市区镇行政区划数据带拼音标注、教育行业新闻语料库包含自动文摘功能、开放了对话机器人-知识图谱-语义理解-自然语言处理工具及数据、中文知识图谱:基于百度百科中文页面-抽取三元组信息-构建中文知识图谱、masr: 中文语音识别-提供预训练模型-高识别率、Python音频数据增广库、中文全词覆盖BERT及两份阅读理解数据、ConvLab:开源多域端到端对话系统平台、中文自然语言处理数据集、基于最新版本rasa搭建的对话系统、基于TensorFlow和BERT的管道式实体及关系抽取、一个小型的证券知识图谱/知识库、复盘所有NLP比赛的TOP方案、OpenCLaP:多领域开源中文预训练语言模型仓库、UER:基于不同语料+编码器+目标任务的中文预训练模型仓库、中文自然语言处理向量合集、基于金融-司法领域(兼有闲聊性质)的聊天机器人、g2pC:基于上下文的汉语读音自动标记模块、Zincbase 知识图谱构建工具包、诗歌质量评价/细粒度情感诗歌语料库、快速转化「中文数字」和「阿拉伯数字」、百度知道问答语料库、基于知识图谱的问答系统、jieba_fast 加速版的jieba、正则表达式教程、中文阅读理解数据集、基于BERT等最新语言模型的抽取式摘要提取、Python利用深度学习进行文本摘要的综合指南、知识图谱深度学习相关资料整理、维基大规模平行文本语料、StanfordNLP 0.2.0:纯Python版自然语言处理包、NeuralNLP-NeuralClassifier:腾讯开源深度学习文本分类工具、端到端的封闭域对话系统、中文命名实体识别:NeuroNER vs. BertNER、新闻事件线索抽取、2019年百度的三元组抽取比赛:“科学空间队”源码、基于依存句法的开放域文本知识三元组抽取和知识库构建、中文的GPT2训练代码、ML-NLP - 机器学习(Machine Learning)NLP面试中常考到的知识点和代码实现、nlp4han:中文自然语言处理工具集(断句/分词/词性标注/组块/句法分析/语义分析/NER/N元语法/HMM/代词消解/情感分析/拼写检查、XLM:Facebook的跨语言预训练语言模型、用基于BERT的微调和特征提取方法来进行知识图谱百度百科人物词条属性抽取、中文自然语言处理相关的开放任务-数据集-当前最佳结果、CoupletAI - 基于CNN+Bi-LSTM+Attention 的自动对对联系统、抽象知识图谱、MiningZhiDaoQACorpus - 580万百度知道问答数据挖掘项目、brat rapid annotation tool: 序列标注工具、大规模中文知识图谱数据:1.4亿实体、数据增强在机器翻译及其他nlp任务中的应用及效果、allennlp阅读理解:支持多种数据和模型、PDF表格数据提取工具 、 Graphbrain:AI开源软件库和科研工具,目的是促进自动意义提取和文本理解以及知识的探索和推断、简历自动筛选系统、基于命名实体识别的简历自动摘要、中文语言理解测评基准,包括代表性的数据集&基准模型&语料库&排行榜、树洞 OCR 文字识别 、从包含表格的扫描图片中识别表格和文字、语声迁移、Python口语自然语言处理工具集(英文)、 similarity:相似度计算工具包,java编写、海量中文预训练ALBERT模型 、Transformers 2.0 、基于大规模音频数据集Audioset的音频增强 、Poplar:网页版自然语言标注工具、图片文字去除,可用于漫画翻译 、186种语言的数字叫法库、Amazon发布基于知识的人-人开放领域对话数据集 、中文文本纠错模块代码、繁简体转换 、 Python实现的多种文本可读性评价指标、类似于人名/地名/组织机构名的命名体识别数据集 、东南大学《知识图谱》研究生课程(资料)、. 英文拼写检查库 、 wwsearch是企业微信后台自研的全文检索引擎、CHAMELEON:深度学习新闻推荐系统元架构 、 8篇论文梳理BERT相关模型进展与反思、DocSearch:免费文档搜索引擎、 LIDA:轻量交互式对话标注工具 、aili - the fastest in-memory index in the East 东半球最快并发索引 、知识图谱车音工作项目、自然语言生成资源大全 、中日韩分词库mecab的Python接口库、中文文本摘要/关键词提取、汉字字符特征提取器 (featurizer),提取汉字的特征(发音特征、字形特征)用做深度学习的特征、中文生成任务基准测评 、中文缩写数据集、中文任务基准测评 - 代表性的数据集-基准(预训练)模型-语料库-baseline-工具包-排行榜、PySS3:面向可解释AI的SS3文本分类器机器可视化工具 、中文NLP数据集列表、COPE - 格律诗编辑程序、doccano:基于网页的开源协同多语言文本标注工具 、PreNLP:自然语言预处理库、简单的简历解析器,用来从简历中提取关键信息、用于中文闲聊的GPT2模型:GPT2-chitchat、基于检索聊天机器人多轮响应选择相关资源列表(Leaderboards、Datasets、Papers)、(Colab)抽象文本摘要实现集锦(教程 、词语拼音数据、高效模糊搜索工具、NLP数据增广资源集、微软对话机器人框架 、 GitHub Typo Corpus:大规模GitHub多语言拼写错误/语法错误数据集、TextCluster:短文本聚类预处理模块 Short text cluster、面向语音识别的中文文本规范化、BLINK:最先进的实体链接库、BertPunc:基于BERT的最先进标点修复模型、Tokenizer:快速、可定制的文本词条化库、中文语言理解测评基准,包括代表性的数据集、基准(预训练)模型、语料库、排行榜、spaCy 医学文本挖掘与信息提取 、 NLP任务示例项目代码集、 python拼写检查库、chatbot-list - 行业内关于智能客服、聊天机器人的应用和架构、算法分享和介绍、语音质量评价指标(MOSNet, BSSEval, STOI, PESQ, SRMR)、 用138GB语料训练的法文RoBERTa预训练语言模型 、BERT-NER-Pytorch:三种不同模式的BERT中文NER实验、无道词典 - 有道词典的命令行版本,支持英汉互查和在线查询、2019年NLP亮点回顾、 Chinese medical dialogue data 中文医疗对话数据集 、最好的汉字数字(中文数字)-阿拉伯数字转换工具、 基于百科知识库的中文词语多词义/义项获取与特定句子词语语义消歧、awesome-nlp-sentiment-analysis - 情感分析、情绪原因识别、评价对象和评价词抽取、LineFlow:面向所有深度学习框架的NLP数据高效加载器、中文医学NLP公开资源整理 、MedQuAD:(英文)医学问答数据集、将自然语言数字串解析转换为整数和浮点数、Transfer Learning in Natural Language Processing (NLP) 、面向语音识别的中文/英文发音辞典、Tokenizers:注重性能与多功能性的最先进分词器、CLUENER 细粒度命名实体识别 Fine Grained Named Entity Recognition、 基于BERT的中文命名实体识别、中文谣言数据库、NLP数据集/基准任务大列表、nlp相关的一些论文及代码, 包括主题模型、词向量(Word Embedding)、命名实体识别(NER)、文本分类(Text Classificatin)、文本生成(Text Generation)、文本相似性(Text Similarity)计算等,涉及到各种与nlp相关的算法,基于keras和tensorflow 、Python文本挖掘/NLP实战示例、 Blackstone:面向非结构化法律文本的spaCy pipeline和NLP模型通过同义词替换实现文本“变脸” 、中文 预训练 ELECTREA 模型: 基于对抗学习 pretrain Chinese Model 、albert-chinese-ner - 用预训练语言模型ALBERT做中文NER 、基于GPT2的特定主题文本生成/文本增广、开源预训练语言模型合集、多语言句向量包、编码、标记和实现:一种可控高效的文本生成方法、 英文脏话大列表 、attnvis:GPT2、BERT等transformer语言模型注意力交互可视化、CoVoST:Facebook发布的多语种语音-文本翻译语料库,包括11种语言(法语、德语、荷兰语、俄语、西班牙语、意大利语、土耳其语、波斯语、瑞典语、蒙古语和中文)的语音、文字转录及英文译文、Jiagu自然语言处理工具 - 以BiLSTM等模型为基础,提供知识图谱关系抽取 中文分词 词性标注 命名实体识别 情感分析 新词发现 关键词 文本摘要 文本聚类等功能、用unet实现对文档表格的自动检测,表格重建、NLP事件提取文献资源列表 、 金融领域自然语言处理研究资源大列表、CLUEDatasetSearch - 中英文NLP数据集:搜索所有中文NLP数据集,附常用英文NLP数据集 、medical_NER - 中文医学知识图谱命名实体识别 、(哈佛)讲因果推理的免费书、知识图谱相关学习资料/数据集/工具资源大列表、Forte:灵活强大的自然语言处理pipeline工具集 、Python字符串相似性算法库、PyLaia:面向手写文档分析的深度学习工具包、TextFooler:针对文本分类/推理的对抗文本生成模块、Haystack:灵活、强大的可扩展问答(QA)框架、中文关键短语抽取工具

Pros of funNLP

- More comprehensive collection of NLP resources, including tools, datasets, and algorithms

- Regularly updated with new content and contributions from the community

- Covers a wider range of NLP tasks and applications beyond just corpus data

Cons of funNLP

- Less focused on providing large-scale, ready-to-use Chinese corpora

- May require more effort to navigate and find specific resources due to its broad scope

- Some resources might be outdated or less maintained compared to nlp_chinese_corpus

Code comparison

nlp_chinese_corpus:

with open('news_chinese.txt', 'r', encoding='utf-8') as f:

news_data = f.read().splitlines()

funNLP:

import jieba

text = "自然语言处理是人工智能的一个重要分支"

words = jieba.cut(text)

print(" ".join(words))

The code snippets demonstrate the difference in focus between the two repositories. nlp_chinese_corpus provides ready-to-use corpus data, while funNLP offers tools and algorithms for NLP tasks like word segmentation.

搜集、整理、发布 中文 自然语言处理 语料/数据集,与 有志之士 共同 促进 中文 自然语言处理 的 发展。

Pros of ChineseNlpCorpus

- More diverse dataset types, including news, conversations, and social media content

- Better documentation and organization of datasets

- Includes pre-processed data for specific NLP tasks

Cons of ChineseNlpCorpus

- Smaller overall corpus size compared to nlp_chinese_corpus

- Less frequent updates and maintenance

- Limited support for advanced NLP tasks like machine translation

Code Comparison

nlp_chinese_corpus:

import json

with open('weibo_senti_100k.json', 'r', encoding='utf-8') as f:

data = json.load(f)

for item in data:

print(item['text'], item['label'])

ChineseNlpCorpus:

import pandas as pd

df = pd.read_csv('weibo_senti_100k.csv', encoding='utf-8')

for index, row in df.iterrows():

print(row['text'], row['label'])

Both repositories provide valuable Chinese NLP datasets, but they cater to different needs. nlp_chinese_corpus offers a larger corpus with a focus on raw data, while ChineseNlpCorpus provides more diverse and pre-processed datasets for specific NLP tasks. The choice between the two depends on the specific requirements of your project and the level of data preprocessing you need.

:herb: 中文近义词:聊天机器人,智能问答工具包

Pros of Synonyms

- Focused specifically on Chinese synonyms and word similarity

- Provides a simple API for easy integration into other projects

- Includes pre-trained word vectors for quick setup and usage

Cons of Synonyms

- More limited in scope compared to the broader nlp_chinese_corpus

- May not be as suitable for general-purpose NLP tasks

- Smaller dataset size, potentially limiting its effectiveness in some scenarios

Code Comparison

Synonyms:

import synonyms

synonyms.seg("中文近义词工具包")

synonyms.nearby("中文")

nlp_chinese_corpus:

# No direct code comparison available

# nlp_chinese_corpus is a data repository, not a functional library

Summary

Synonyms is a specialized tool for Chinese synonyms and word similarity, offering a simple API and pre-trained word vectors. It's more focused but limited in scope compared to nlp_chinese_corpus, which provides a broader range of Chinese NLP datasets. Synonyms is better suited for specific synonym-related tasks, while nlp_chinese_corpus serves as a comprehensive resource for various Chinese NLP applications.

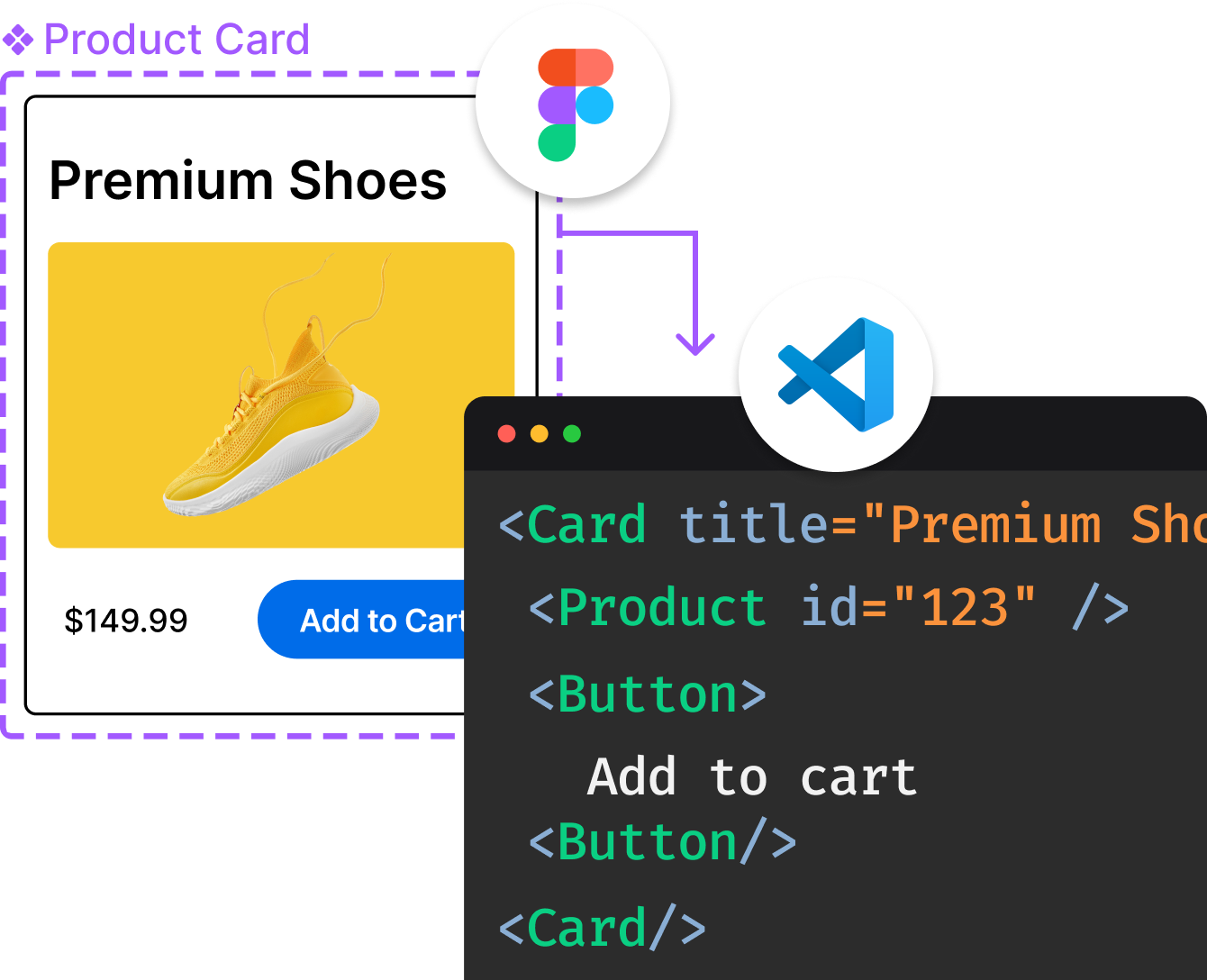

Convert  designs to code with AI

designs to code with AI

Introducing Visual Copilot: A new AI model to turn Figma designs to high quality code using your components.

Try Visual CopilotREADME

为ä¸æèªç¶è¯è¨å¤çé¢ååå±è´¡ç®è¯æ

ãç çæ¦ã-ä¸æ大模åä¸ç¨ç«æåºï¼ä½ å ³å¿çé¢å 模åé½å¨è¿é

SuperCLUE: ä¸æéç¨å¤§æ¨¡å综åæ§æµè¯åºå

*** update ****

ä¸æä»»å¡åºåæµè¯ï¼10å¤§ä»»å¡ & 9个模åä¸é®è¿è¡ã详ç»æµè¯ï¼

Language Understanding Evaluation benchmark for Chinese(CLUE benchmark): run 10 tasks & 9 baselines with one line of code, performance comparision with details.

Releasing Pre-trained Model of ALBERT_Chinese:

Training with 30G+ Raw Chinese Corpus, xxlarge, small version and more, Target to match State of the Art performance in Chinese with 30% less parameters, 2019-Oct-7, During the National Day of China!

è¯æåºå°ä¼ä¸ææ©å ããã

ä¸æç®æ ï¼10个ç¾ä¸çº§ä¸æè¯æ & 3个åä¸çº§ä¸æè¯æ(2019å¹´5æ1å·)

äºæç®æ ï¼30个ç¾ä¸çº§ä¸æè¯æ & 10个åä¸çº§ä¸æè¯æ & 1个亿级ä¸æè¯æï¼2019å¹´12æ31æ¥ï¼

Updateï¼ å¢å é«è´¨é社åºé®çjsonç(webtext2019zh)ï¼å¯ç¨äºè®ç»è¶ 大è§æ¨¡NLP模åï¼æ·»å 520ä¸ç¿»è¯è¯æ(translation2019zh)ã

1.ç»´åºç¾ç§(wiki2019zh)ï¼100ä¸ä¸ªç»æè¯å¥½çä¸æè¯æ¡

2.æ°é»è¯æ(news2016zh)ï¼250ä¸ç¯æ°é»ï¼å«å ³é®è¯ãæè¿°

3.ç¾ç§é®ç(baike2018qa)ï¼150ä¸ä¸ªå¸¦é®é¢ç±»åçé®ç

4.社åºé®çjsonç(webtext2019zh)ï¼410ä¸ä¸ªé«è´¨é社åºé®çï¼éåè®ç»è¶ 大模å

5.ç¿»è¯è¯æ(translation2019zh)ï¼520ä¸ä¸ªä¸è±æå¥å对

为ä»ä¹éè¦è¿ä¸ªé¡¹ç®

ä¸æçä¿¡æ¯æ å¤ä¸å¨ï¼ä½å¦ææ³è¦è·å¾å¤§éçä¸æè¯æï¼å´æ¯ä¸å¤ªå®¹æï¼ææ¶çè³é常å°é¾ãå¨2019å¹´åè¿ä¸ªæ¶ç¹ä¸ï¼

æ®éçä»ä¸è ãç 究人åæå¦çï¼å¹¶æ²¡æä¸ä¸ªæ¯è¾å¥½çæ¸ éè·å¾æ大éçä¸æè¯æãç¬è æ³è¦è®ç»ä¸ä¸ªä¸æçè¯åéï¼

å¨ç¾åº¦ågithubä¸ä¸æç´¢äºå¥½ä¹ ï¼æ¶è·å´å¾å°ï¼è¦ä¹è¯æçé级太å°ï¼è¦ä¹æ°æ®è¿äºææ§ï¼æéè¦çå¤ç太å¤æã

ä¸ç¥éä½ æ¯å¦ä¹éå°äºè¿æ ·çé®é¢ï¼

æ们è¿ä¸ªé¡¹ç®ï¼å°±æ¯ä¸ºäºè§£å³è¿ä¸é®é¢è´¡ç®å¾®èä¹åã

1.ç»´åºç¾ç§jsonç(wiki2019zh)

104ä¸ä¸ªè¯æ¡(1,043,224æ¡; åå§æ件大å°1.6Gï¼å缩æ件519Mï¼æ°æ®æ´æ°æ¶é´ï¼2019.2.7)

Google Driveä¸è½½ æ ç¾åº¦äºç

å¯è½çç¨éï¼

å¯ä»¥å为éç¨ä¸æè¯æï¼åé¢è®ç»çè¯æææ建è¯åéï¼ä¹å¯ä»¥ç¨äºæ建ç¥è¯é®çã

ç»æï¼

{"id":<id>,"url":<url>,"title":<title>,"text":<text>} å

¶ä¸ï¼titleæ¯è¯æ¡çæ é¢ï¼textæ¯æ£æï¼éè¿"\n\n"æ¢è¡ã

ä¾åï¼

{"id": "53", "url": "https://zh.wikipedia.org/wiki?curid=53", "title": "ç»æµå¦", "text": "ç»æµå¦\n\nç»æµå¦æ¯ä¸é¨å¯¹äº§ååæå¡çç产ãåé

以åæ¶è´¹è¿è¡ç 究ç社ä¼ç§å¦ã西æ¹è¯è¨ä¸çâç»æµå¦âä¸è¯æºäºå¤å¸è

çã\n\nç»æµå¦æ³¨éçæ¯ç 究ç»æµè¡ä¸ºè

å¨ä¸ä¸ªç»æµä½ç³»ä¸çè¡ä¸ºï¼ä»¥åä»ä»¬å½¼æ¤ä¹é´çäºå¨ãå¨ç°ä»£ï¼ç»æµå¦çææé常å°è¿é¨é¢åçç 究å为æ»ä½ç»æµå¦å个ä½ç»æµå¦ãå¾®è§ç»æµå¦æ£è§ä¸ä¸ªç¤¾ä¼éåºæ¬å±æ¬¡çè¡ä¸ºï¼å

æ¬ä¸ªä½çè¡ä¸ºè

ï¼ä¾å¦ä¸ªäººãå

¬å¸ã买家æå家ï¼ä»¥åä¸å¸åºçäºå¨ãèå®è§ç»æµå¦ååææ´ä¸ªç»æµä½åå

¶è®®é¢ï¼å

æ¬å¤±ä¸ãéè´§è¨èãç»æµæé¿ãè´¢æ¿åè´§å¸æ¿ççã..."}

ææï¼

ç»æµå¦

ç»æµå¦æ¯ä¸é¨å¯¹äº§ååæå¡çç产ãåé

以åæ¶è´¹è¿è¡ç 究ç社ä¼ç§å¦ã西æ¹è¯è¨ä¸çâç»æµå¦âä¸è¯æºäºå¤å¸è

çã

ç»æµå¦æ³¨éçæ¯ç 究ç»æµè¡ä¸ºè

å¨ä¸ä¸ªç»æµä½ç³»ä¸çè¡ä¸ºï¼ä»¥åä»ä»¬å½¼æ¤ä¹é´çäºå¨ãå¨ç°ä»£ï¼ç»æµå¦çææé常å°è¿é¨é¢åçç 究å为æ»ä½ç»æµå¦å个ä½ç»æµå¦ãå¾®è§ç»æµå¦æ£è§ä¸ä¸ªç¤¾ä¼éåºæ¬å±æ¬¡çè¡ä¸ºï¼å

æ¬ä¸ªä½çè¡ä¸ºè

ï¼ä¾å¦ä¸ªäººãå

¬å¸ã买家æå家ï¼ä»¥åä¸å¸åºçäºå¨ãèå®è§ç»æµå¦ååææ´ä¸ªç»æµä½åå

¶è®®é¢ï¼å

æ¬å¤±ä¸ãéè´§è¨èãç»æµæé¿ãè´¢æ¿åè´§å¸æ¿ççã

å

¶ä»ç对ç

§è¿å

æ¬äºå®è¯ç»æµå¦ï¼ç 究ãæ¯ä»ä¹ãï¼ä»¥åè§èç»æµå¦ï¼ç 究ãåºè¯¥æ¯ä»ä¹ãï¼ãç»æµç论ä¸å®ç¨ç»æµå¦ãè¡ä¸ºç»æµå¦ä¸çæ§éæ©ç»æµå¦ã主æµç»æµå¦ï¼ç 究çæ§-个ä½-åè¡¡çï¼ä¸é主æµç»æµå¦ï¼ç 究ä½å¶-åå²-社ä¼ç»æçï¼ã

ç»æµå¦çåæä¹è¢«ç¨å¨å

¶ä»åç§é¢åä¸ï¼ä¸»è¦é¢åå

æ¬äºåä¸ãéèãåæ¿åºçï¼ä½åæ¶ä¹å

æ¬äºå¦å¥åº·ãç¯ç½ªãæè²ãæ³å¾ãæ¿æ²»ã社ä¼æ¶æãå®æãæäºãåç§å¦ççãå°äº21ä¸çºªåï¼ç»æµå¦å¨ç¤¾ä¼ç§å¦é¢ååæ¹é¢ä¸ææ©å¼ å½±ååï¼ä½¿å¾æäºå¦è

讽åºå°ç§°å

¶ä¸ºãç»æµå¦å¸å½ä¸»ä¹ãã

å¨ç°ä»£å¯¹äºç»æµå¦çå®ä¹ææ°ç§è¯´æ³ï¼å

¶ä¸æ许å¤è¯´æ³å 为åå±èªä¸åçé¢åæç论èææªç¶ä¸åçå®ä¹ï¼èæ ¼å

°å²å¦å®¶åç»æµå¦å®¶äºå½Â·æ¯å¯å¨1776å¹´å°æ¿æ²»ç»æµå¦å®ä¹ä¸ºãå½æ°è´¢å¯çæ§è´¨ååå çç 究ãï¼ä»è¯´ï¼

让-å·´èæ¯ç¹Â·èµä¼å¨1803å¹´å°ç»æµå¦ä»å

Œ

±æ¿çéç¬ç«åºæ¥ï¼å¹¶å®ä¹å

¶ä¸ºå¯¹äºè´¢å¯ä¹ç产ãåé

ãåæ¶è´¹çå¦é®ãå¦ä¸æ¹é¢ï¼æ马æ¯Â·å¡è±å°å讽åºç称ç»æµå¦ä¸ºã忧éçç§å¦ãï¼Dismal scienceï¼ï¼ä¸è¿è¿ä¸è¯ææ©æ¯ç±é©¬å°è¨æ¯å¨1798å¹´æåºã约翰·æ¯å¾å°ç¹Â·å¯å°å¨1844å¹´æåºäºä¸ä¸ªä»¥ç¤¾ä¼ç§å¦å®ä¹ç»æµå¦çè§åº¦ï¼

.....

2.æ°é»è¯æjsonç(news2016zh)

250ä¸ç¯æ°é»( åå§æ°æ®9Gï¼å缩æ件3.6Gï¼æ°é»å 容跨度ï¼2014-2016å¹´)

Google Driveä¸è½½æ ç¾åº¦äºçä¸è½½ï¼å¯ç :k265

æ°æ®æè¿°

å å«äº250ä¸ç¯æ°é»ãæ°é»æ¥æºæ¶µçäº6.3ä¸ä¸ªåªä½ï¼å«æ é¢ãå ³é®è¯ãæè¿°ãæ£æã

æ°æ®éååï¼æ°æ®å»é并åæä¸ä¸ªé¨åãè®ç»éï¼243ä¸ï¼éªè¯éï¼7.7ä¸ï¼æµè¯éï¼æ°ä¸ï¼ä¸æä¾ä¸è½½ã

å¯è½çç¨éï¼

å¯ä»¥å为ãéç¨ä¸æè¯æãï¼è®ç»ãè¯åéãæå为ãé¢è®ç»ãçè¯æï¼

ä¹å¯ä»¥ç¨äºè®ç»ãæ é¢çæã模åï¼æè®ç»ãå

³é®è¯çæã模åï¼éå

³é®è¯å

容ä¸åäºæ é¢çæ°æ®ï¼ï¼

亦å¯ä»¥éè¿æ°é»æ¸ éåºååºæ°é»çç±»åã

ç»æï¼

{'news_id': <news_id>,'title':<title>,'content':<content>,'source': <source>,'time':<time>,'keywords': <keywords>,'desc': <desc>, 'desc': <desc>}

å

¶ä¸ï¼titleæ¯æ°é»æ é¢ï¼contentæ¯æ£æï¼keywordsæ¯å

³é®è¯ï¼descæ¯æè¿°ï¼sourceæ¯æ°é»çæ¥æºï¼timeæ¯åå¸æ¶é´

ä¾åï¼

{"news_id": "610130831", "keywords": "导游ï¼é¨ç¥¨","title": "æ

宫淡å£é¨ç¥¨40å

âé»å¯¼æ¸¸âåå¤å°å®¢140å

", "desc": "è¿æ¥æç½åå¾®åçæ称ï¼æ

宫åé¨å¹¿åºå®ç¥¨å¤åºç°âé»å¯¼æ¸¸âï¼ä¸é¨åå¤å°æ¸¸å®¢åºå®é«ä»·é¨ç¥¨ãæ¨æ¥ï¼è®°è

å®å°æ¢è®¿æ

宫ï¼åç°âé»å¯¼æ¸¸âç¡®å®åå¨ãçªå£åºå®", "source": "æ°åç½", "time": "03-22 12:00", "content": "è¿æ¥æç½åå¾®åçæ称ï¼æ

宫åé¨å¹¿åºå®ç¥¨å¤åºç°âé»å¯¼æ¸¸âï¼ä¸é¨åå¤å°æ¸¸å®¢åºå®é«ä»·é¨ç¥¨ãæ¨æ¥ï¼è®°è

å®å°æ¢è®¿æ

宫ï¼åç°âé»å¯¼æ¸¸âç¡®å®åå¨ãçªå£åºå®40å

çé¨ç¥¨ï¼è¢«âé»å¯¼æ¸¸âå ä»·åºå®ï¼æé«å å°140å

ãæ

宫æ¹é¢è¡¨ç¤ºï¼è¯·æ¸¸å®¢å¡å¿

éè¿æ£è§æ¸ éè´ä¹°é¨ç¥¨ï¼é¿å

ä¸å½åéªéåæ失ãç®ååç¬é¨ç¥¨è´ä¹°æµç¨ä¸è¿å ç§éï¼èå¿æéè´ç¥¨ä¹ä¸ä¼çå¾

太é¿æ¶é´ã....ååå¼¹âçæå¿ï¼æå»é»å¯¼æ¸¸éè¦æ¸¸å®¢é

åï¼éè¿æ£è§æ¸ éè´ä¹°é¨ç¥¨ã"}

3.ç¾ç§ç±»é®çjsonç(baike2018qa)

150ä¸ä¸ªé®ç( åå§æ°æ®1Gå¤ï¼å缩æ件663Mï¼æ°æ®æ´æ°æ¶é´ï¼2018å¹´)

Google Driveä¸è½½ æ ç¾åº¦äºçä¸è½½ï¼å¯ç :fu45

æ°æ®æè¿°

å«æ150ä¸ä¸ªé¢å è¿æ»¤è¿çãé«è´¨éé®é¢åçæ¡ï¼æ¯ä¸ªé®é¢å±äºä¸ä¸ªç±»å«ãæ»å ±æ492个类å«ï¼å ¶ä¸é¢çè¾¾å°æè¶ è¿10次çç±»å«æ434个ã

æ°æ®éååï¼æ°æ®å»é并åæä¸ä¸ªé¨åãè®ç»éï¼142.5ä¸ï¼éªè¯éï¼4.5ä¸ï¼æµè¯éï¼æ°ä¸ï¼ä¸æä¾ä¸è½½ã

å¯è½çç¨éï¼

å¯ä»¥å为éç¨ä¸æè¯æï¼è®ç»è¯åéæå为é¢è®ç»çè¯æï¼ä¹å¯ä»¥ç¨äºæ建ç¾ç§ç±»é®çï¼å

¶ä¸ç±»å«ä¿¡æ¯æ¯è¾æç¨ï¼å¯ä»¥ç¨äºåçç£è®ç»ï¼ä»èæ建

æ´å¥½å¥å表示ç模åãå¥åç¸ä¼¼æ§ä»»å¡çã

ç»æï¼

{"qid":<qid>,"category":<category>,"title":<title>,"desc":<desc>,"answer":<answer>}

å

¶ä¸ï¼categoryæ¯é®é¢çç±»åï¼titleæ¯é®é¢çæ é¢ï¼descæ¯é®é¢çæè¿°ï¼å¯ä»¥ä¸ºç©ºæä¸æ é¢å

容ä¸è´ã

ä¾åï¼

{"qid": "qid_2540946131115409959", "category": "çæ´»ç¥è¯", "title": "å¬å¤©è¿è¡¥å¥½ä¸äºå¢ï¼è¿æ¯å¤å¤©è¿æ¥å¥½åï¼ ", "desc": "", "answer": "ä½ å¥½ï¼\r\rå½ç¶æ¯å¬å¤©è¿è¡¥å¥½çäºï¼å¤å¤©äººä½çèå¤äºæ¶ç¼©ç¶æï¼ä¸éå®å¤§éçè¿è¡¥ï¼æ以æ们ææ¶å说ï¼âå¤å¤©å°±è¦åäºæ¸

æ·¡çï¼å°±æ¯è¿ä¸ªéççãâ\r\rä¸è¿ï¼ç§å£è¿è¡¥è¦æ³¨æâåå¿â ä¸å¿å¤å¤çåãä»»ä½è¡¥è¯æç¨è¿éé½æ害ã认为âå¤åè¡¥è¯ï¼æç

æ²»ç

ï¼æ ç

强身âæ¯ä¸çãè¿éè¿è¡¥ä¼å éè¾èãèèè´æ

ãå¨å¤å£éï¼äººä»¬ç±äºåå·é¥®ï¼å¸¸é£å»åï¼å¤æè¾èåè½åå¼±çç°è±¡ï¼è¿æ¶åå¦æçªç¶å¤§éè¿è¡¥ï¼ä¼éª¤ç¶å éè¾èåèèçè´æ

ï¼ä½¿é¿æå¤äºç²å¼±çæ¶åå¨å®é¾äºæ¿åï¼å¯¼è´æ¶åå¨å®åè½ç´ä¹±ã \r\räºå¿ä»¥è¯ä»£é£ãéè¯ç©è½»é£ç©çåæ³æ¯ä¸ç§å¦çï¼è®¸å¤é£ç©ä¹æ¯å¥½çæ»è¡¥åãå¦å¤åè èå¯æ²»çé«è¡åï¼å¤åèåå¯å¥èæ¶é£ï¼é¡ºæ°å®½è¸ï¼å¤åå±±è¯è½è¡¥è¾èãæ¥å¸¸é£ç¨çè¡æ¡ãè麻ãè±çã红æ£ãæè±çä¹æ¯è¿è¡¥çä½³åã\r\rä¸å¿è¶è´µè¶å¥½ãæ¯ä¸ªäººç身ä½ç¶åµä¸åï¼å æ¤ä¸ä¹ç¸éåºçè¡¥åä¹æ¯ä¸åçãä»·æ ¼æè´µçè¡¥åå¦ççªã人åä¹ç±»å¹¶é对æ¯ä¸ªäººé½éåãæ¯ç§è¿è¡¥åé½æä¸å®ç对象åéåºçï¼åºä»¥å®ç¨ææ为æ»è¡¥ååï¼ç¼ºå¥è¡¥å¥ã \r\råå¿åªè¡¥èç±»ãç§å£éå½é£ç¨çç¾èè¿è¡¥ææ好ãä½ç»è¿å¤å£åï¼ç±äºè¾èå°æªå®å

¨æ¢å¤å°æ£å¸¸åè½ï¼å æ¤è¿äºæ²¹è

»çé£åä¸ææ¶åå¸æ¶ãå¦å¤ï¼ä½å

è¿å¤çèç±»ãç³ç±»çç©è´¨å 积å¯è½è¯±åå¿èè¡ç®¡ç

ã"}

å ¬å¼è¯æµï¼

欢è¿æ¥å模åå¨éªè¯éä¸çåç¡®çãä»»å¡1ï¼ ç±»å«é¢æµã

æ¥åå æ¬ï¼#1ï¼éªè¯éä¸åç¡®çï¼#2ï¼éç¨ç模åãæ¹æ³æè¿°ãè¿è¡æ¹å¼ï¼1页PDFï¼#3ï¼å¯è¿è¡çæºä»£ç (å¯é)

åºäº#2å#3ï¼æ们ä¼å¨æµè¯éä¸åæµè¯ï¼å¹¶æ¥åæµè¯éä¸çåç¡®çï¼åªæä¾äº#1å#2çéä¼ï¼éªè¯éä¸çæ绩ä¾ç¶å¯ä»¥è¢«æ¾ç¤ºåºæ¥ï¼ä½ä¼è¢«æ 记为æªéªè¯ã

4.社åºé®çjsonç(webtext2019zh) ï¼å¤§è§æ¨¡é«è´¨éæ°æ®é

410ä¸ä¸ªé®ç( è¿æ»¤åæ°æ®3.7Gï¼å缩æ件1.7Gï¼æ°æ®è·¨åº¦ï¼2015-2016å¹´)

æ°æ®æè¿°

å«æ410ä¸ä¸ªé¢å è¿æ»¤è¿çãé«è´¨éé®é¢ååå¤ãæ¯ä¸ªé®é¢å±äºä¸ä¸ªãè¯é¢ãï¼æ»å ±æ2.8ä¸ä¸ªåå¼è¯é¢ï¼è¯é¢å ç½ä¸è±¡ã

ä»1400ä¸ä¸ªåå§é®çä¸ï¼çéåºè³å°è·å¾3个ç¹èµä»¥ä¸çççæ¡ï¼ä»£è¡¨äºåå¤çå 容æ¯è¾ä¸éææ趣ï¼ä»èè·å¾é«è´¨éçæ°æ®éã

é¤äºå¯¹æ¯ä¸ªé®é¢å¯¹åºä¸ä¸ªè¯é¢ãé®é¢çæè¿°ãä¸ä¸ªæå¤ä¸ªåå¤å¤ï¼æ¯ä¸ªåå¤è¿å¸¦æç¹èµæ°ãåå¤IDãåå¤è çæ ç¾ã

æ°æ®éååï¼æ°æ®å»é并åæä¸ä¸ªé¨åãè®ç»éï¼412ä¸ï¼éªè¯éï¼6.8ä¸ï¼æµè¯éaï¼6.8ä¸ï¼æµè¯ébï¼ä¸æä¾ä¸è½½ã

å¯è½çç¨éï¼

1ï¼æ建ç¾ç§ç±»é®çï¼è¾å

¥ä¸ä¸ªé®é¢ï¼æ建æ£ç´¢ç³»ç»å¾å°ä¸ä¸ªåå¤æç产ä¸ä¸ªåå¤ï¼ææ ¹æ®ç¸å

³å

³é®è¯ä»ï¼ç¤¾åºé®çåºä¸çéåºä½ ç¸å

³çé¢åæ°æ®

2ï¼è®ç»è¯é¢é¢æµæ¨¡åï¼è¾å

¥ä¸ä¸ªé®é¢(åææè¿°)ï¼é¢æµå±äºè¯é¢ã

3ï¼è®ç»ç¤¾åºé®ç(cQA)ç³»ç»ï¼é对ä¸é®å¤ççåºæ¯ï¼è¾å

¥ä¸ä¸ªé®é¢ï¼æ¾å°æç¸å

³çé®é¢ï¼å¨è¿ä¸ªåºç¡ä¸åºäºä¸åçæ¡åå¤çè´¨éã

é®é¢ä¸çæ¡çç¸å

³æ§ï¼æ¾å°æ好ççæ¡ã

4ï¼å为éç¨ä¸æè¯æï¼å大模åé¢è®ç»çè¯ææè®ç»è¯åéãå

¶ä¸ç±»å«ä¿¡æ¯ä¹æ¯è¾æç¨ï¼å¯ä»¥ç¨äºåçç£è®ç»ï¼ä»èæ建æ´å¥½å¥å表示ç模åãå¥åç¸ä¼¼æ§ä»»å¡çã

5ï¼ç»åç¹èµæ°éè¿ä¸é¢å¤ä¿¡æ¯ï¼é¢æµåå¤çå欢è¿ç¨åº¦æè®ç»çæ¡è¯åç³»ç»ã

ç»æï¼

{"qid":<qid>,"title":<title>,"desc":<desc>,"topic":<topic>,"star":<star>,"content":<content>,

"answer_id":<answer_id>,"answerer_tags":<answerer_tags>}

å

¶ä¸ï¼qidæ¯é®é¢çidï¼titleæ¯é®é¢çæ é¢ï¼descæ¯é®é¢çæè¿°ï¼å¯ä»¥ä¸ºç©ºï¼topicæ¯é®é¢æå±çè¯é¢ï¼staræ¯è¯¥åå¤çç¹èµä¸ªæ°ï¼

contentæ¯åå¤çå

容ï¼answer_idæ¯åå¤çID,answerer_tagsæ¯åå¤è

ææºå¸¦çæ ç¾

ä¾åï¼

{"qid": 65618973, "title": "AlphaGoåªä¼ä¸å´æ£åï¼é¿æ³çè½åå°è¯´åï¼", "desc": "é£ä¹ç°å¨ä¼ä¸ä¼ææºè½æºå¨äººè½ä»äºæå¦åä½ï¼<br>å¦ææï¼è½ååºä»ä¹æ°´å¹³çä½åï¼", "topic": "æºå¨äºº", "star": 3, "content": "AlphaGoåªä¼ä¸å´æ£ï¼å 为å®ç设计ç®çï¼æ¶æï¼ææ¯æ¹æ¡ä»¥åè®ç»æ°æ®ï¼é½æ¯å´ç»ä¸å´æ£è¿ä¸ªæ ¸å¿è¿è¡çãå®å¨å´æ£é¢åççªç ´ï¼è¯æäºæ·±åº¦å¦ä¹ 深度强åå¦ä¹ MCTSææ¯å¨å´æ£é¢åçæææ§ï¼å¹¶ä¸åå¾äºé大çPRææãAlphaGoä¸ä¼åå°è¯´ï¼å®æ¯ä¸ç¨çï¼ä¸ä¼åè·¨åºå®é¢åçå

¶å®äºæ

ï¼æ¯å¦è¯é³è¯å«ï¼äººè¸è¯å«ï¼èªå¨é©¾é©¶ï¼åå°è¯´æè

ç解å°è¯´ãå¦æè¦åå°è¯´ï¼éè¦ç¨å°èªç¶è¯è¨å¤çï¼NLPï¼ï¼ä¸çèªç¶è¯è¨çæææ¯ï¼é£æ¯äººå·¥æºè½é¢åä¸ä¸ª", "answer_id": 545576062, "answerer_tags": "人工æºè½@游æä¸"}

å¨è¯¥æ°æ®éä¸çå ¬å¼è¯æµåä»»å¡ï¼

ä»»å¡1ï¼ è¯é¢é¢æµã

æ¥åå æ¬ï¼#1ï¼éªè¯éä¸åç¡®çï¼#2ï¼éç¨ç模åãæ¹æ³æè¿°ãè¿è¡æ¹å¼ï¼1页PDFï¼#3ï¼å¯è¿è¡çæºä»£ç (å¯é)

åºäº#2å#3ï¼æ们ä¼å¨æµè¯éä¸åæµè¯ï¼å¹¶æ¥åæµè¯éä¸çåç¡®çï¼åªæä¾äº#1å#2çéä¼ï¼éªè¯éä¸çæ绩ä¾ç¶å¯ä»¥è¢«æ¾ç¤ºåºæ¥ï¼ä½ä¼è¢«æ 记为æªéªè¯ã

ä»»å¡2ï¼è®ç»ç¤¾åºé®ç(cQA)ç³»ç»ã

è¦æ±ï¼è¯ä»·ææ éç¨MAPï¼æ建ä¸ä¸ªéåæåºé®é¢çæµè¯éï¼å¹¶æ¥åå¨è¯¥æµè¯éä¸çææã

ä»»å¡3ï¼ä½¿ç¨è¯¥æ°æ®éï¼webtext2019zh)ï¼åèOpenAIçGPT-2ï¼è®ç»ä¸æçææ¬åä½æ¨¡åãæµè¯å¨å ¶ä»æ°æ®éä¸çzero-shotçææï¼ææµè¯è¯è¨æ¨¡åçææã

5.ç¿»è¯è¯æ(translation2019zh)

520ä¸ä¸ªä¸è±æå¹³è¡è¯æ( åå§æ°æ®1.1Gï¼å缩æ件596M)

æ°æ®æè¿°

ä¸è±æå¹³è¡è¯æ520ä¸å¯¹ãæ¯ä¸ä¸ªå¯¹ï¼å å«ä¸ä¸ªè±æå对åºçä¸æãä¸ææè±æï¼å¤æ°æ åµæ¯ä¸å¥å¸¦æ ç¹ç¬¦å·çå®æ´çè¯ã

对äºä¸ä¸ªå¹³è¡çä¸è±æ对ï¼ä¸æå¹³åæ36个åï¼è±æå¹³åæ19个åè¯(åè¯å¦âsheâ)

æ°æ®éååï¼æ°æ®å»é并åæä¸ä¸ªé¨åãè®ç»éï¼516ä¸ï¼éªè¯éï¼3.9ä¸ï¼æµè¯éï¼æ°ä¸ï¼ä¸æä¾ä¸è½½ã

å¯è½çç¨éï¼

å¯ä»¥ç¨äºè®ç»ä¸è±æç¿»è¯ç³»ç»ï¼ä»ä¸æç¿»è¯å°è±æï¼æä»è±æç¿»è¯å°ä¸æï¼

ç±äºæä¸ç¾ä¸çä¸æå¥åï¼å¯ä»¥åªæ½åä¸æçå¥åï¼å为éç¨ä¸æè¯æï¼è®ç»è¯åéæå为é¢è®ç»çè¯æãè±æä»»å¡ä¹å¯ä»¥ç±»ä¼¼æä½ï¼

ç»æï¼

{"english": <english>, "chinese": <chinese>}

å

¶ä¸ï¼englishæ¯è±æå¥åï¼chineseæ¯ä¸æå¥åï¼ä¸è±æä¸ä¸å¯¹åºã

ä¾åï¼

{"english": "In Italy, there is no real public pressure for a new, fairer tax system.", "chinese": "å¨æ大å©ï¼å

¬ä¼ä¸ä¼ççåæ¿åºæ½åï¼è¦æ±å®è¡æ°çãæ´å

¬å¹³çç¨æ¶å¶åº¦ã"}

è´¡ç®è¯æ/Contribution

è´¡ç®ä¸æè¯æï¼è¯·åéé®ä»¶è³nlp_chinese_corpus@163.com

为äºå ±å建ç«ä¸ä¸ªå¤§è§æ¨¡å¼æ¾å ±äº«çä¸æè¯æåºï¼ä»¥ä¿è¿ä¸æèªç¶è¯è¨å¤çé¢åçåå±ï¼å¡æä¾è¯æ并被é纳å°è¯¥é¡¹ç®ä¸ï¼

é¤äºä¼ååºè´¡ç®è ååï¼å¯éï¼å¤ï¼æ们ä¼æ ¹æ®è¯æçè´¨éåé级ï¼éåºå20个åå¦ï¼ç»åæ¨çææ¿ï¼å¯åºé®çãé¼ æ ã

æ¾ç¤ºå±ãæ 线è³æºãæºè½é³ç®±æå ¶ä»çå¼çç©åï¼ä»¥è¡¨ç¤ºå¯¹è´¡ç®è çæè°¢ã

add your chinese corpus here by sending us an email

if there is any issue regarding the data, you can also contact with us, we will process it within one week.

thank you for your understanding.

项ç®è´¡ç®è æç»ç»æ¸ å

å¼ç¨ Citation / How do I cite Us?

@misc{bright_xu_2019_3402023,

author = {Bright Xu},

title = {NLP Chinese Corpus: Large Scale Chinese Corpus for NLP },

month = sep,

year = 2019,

doi = {10.5281/zenodo.3402023},

version = {1.0},

publisher = {Zenodo},

url = {https://doi.org/10.5281/zenodo.3402023}

}

ä¹è¯·åé®ä»¶åç¥æ们æ¨ç论æå称æå¨è¿ä¸ªé¡¹ç®çæ°æ®éä¸çå·¥ä½

è´¡ç®ä¸æè¯æï¼è¯·åéé®ä»¶: CLUEbenchmark@163.comï¼

Reference

Top Related Projects

The most comprehensive database of Chinese poetry 🧶最全中华古诗词数据库, 唐宋两朝近一万四千古诗人, 接近5.5万首唐诗加26万宋诗. 两宋时期1564位词人,21050首词。

中文自然语言处理数据集,平时做做实验的材料。欢迎补充提交合并。

中英文敏感词、语言检测、中外手机/电话归属地/运营商查询、名字推断性别、手机号抽取、身份证抽取、邮箱抽取、中日文人名库、中文缩写库、拆字词典、词汇情感值、停用词、反动词表、暴恐词表、繁简体转换、英文模拟中文发音、汪峰歌词生成器、职业名称词库、同义词库、反义词库、否定词库、汽车品牌词库、汽车零件词库、连续英文切割、各种中文词向量、公司名字大全、古诗词库、IT词库、财经词库、成语词库、地名词库、历史名人词库、诗词词库、医学词库、饮食词库、法律词库、汽车词库、动物词库、中文聊天语料、中文谣言数据、百度中文问答数据集、句子相似度匹配算法集合、bert资源、文本生成&摘要相关工具、cocoNLP信息抽取工具、国内电话号码正则匹配、清华大学XLORE:中英文跨语言百科知识图谱、清华大学人工智能技术系列报告、自然语言生成、NLU太难了系列、自动对联数据及机器人、用户名黑名单列表、罪名法务名词及分类模型、微信公众号语料、cs224n深度学习自然语言处理课程、中文手写汉字识别、中文自然语言处理 语料/数据集、变量命名神器、分词语料库+代码、任务型对话英文数据集、ASR 语音数据集 + 基于深度学习的中文语音识别系统、笑声检测器、Microsoft多语言数字/单位/如日期时间识别包、中华新华字典数据库及api(包括常用歇后语、成语、词语和汉字)、文档图谱自动生成、SpaCy 中文模型、Common Voice语音识别数据集新版、神经网络关系抽取、基于bert的命名实体识别、关键词(Keyphrase)抽取包pke、基于医疗领域知识图谱的问答系统、基于依存句法与语义角色标注的事件三元组抽取、依存句法分析4万句高质量标注数据、cnocr:用来做中文OCR的Python3包、中文人物关系知识图谱项目、中文nlp竞赛项目及代码汇总、中文字符数据、speech-aligner: 从“人声语音”及其“语言文本”产生音素级别时间对齐标注的工具、AmpliGraph: 知识图谱表示学习(Python)库:知识图谱概念链接预测、Scattertext 文本可视化(python)、语言/知识表示工具:BERT & ERNIE、中文对比英文自然语言处理NLP的区别综述、Synonyms中文近义词工具包、HarvestText领域自适应文本挖掘工具(新词发现-情感分析-实体链接等)、word2word:(Python)方便易用的多语言词-词对集:62种语言/3,564个多语言对、语音识别语料生成工具:从具有音频/字幕的在线视频创建自动语音识别(ASR)语料库、构建医疗实体识别的模型(包含词典和语料标注)、单文档非监督的关键词抽取、Kashgari中使用gpt-2语言模型、开源的金融投资数据提取工具、文本自动摘要库TextTeaser: 仅支持英文、人民日报语料处理工具集、一些关于自然语言的基本模型、基于14W歌曲知识库的问答尝试--功能包括歌词接龙and已知歌词找歌曲以及歌曲歌手歌词三角关系的问答、基于Siamese bilstm模型的相似句子判定模型并提供训练数据集和测试数据集、用Transformer编解码模型实现的根据Hacker News文章标题自动生成评论、用BERT进行序列标记和文本分类的模板代码、LitBank:NLP数据集——支持自然语言处理和计算人文学科任务的100部带标记英文小说语料、百度开源的基准信息抽取系统、虚假新闻数据集、Facebook: LAMA语言模型分析,提供Transformer-XL/BERT/ELMo/GPT预训练语言模型的统一访问接口、CommonsenseQA:面向常识的英文QA挑战、中文知识图谱资料、数据及工具、各大公司内部里大牛分享的技术文档 PDF 或者 PPT、自然语言生成SQL语句(英文)、中文NLP数据增强(EDA)工具、英文NLP数据增强工具 、基于医药知识图谱的智能问答系统、京东商品知识图谱、基于mongodb存储的军事领域知识图谱问答项目、基于远监督的中文关系抽取、语音情感分析、中文ULMFiT-情感分析-文本分类-语料及模型、一个拍照做题程序、世界各国大规模人名库、一个利用有趣中文语料库 qingyun 训练出来的中文聊天机器人、中文聊天机器人seqGAN、省市区镇行政区划数据带拼音标注、教育行业新闻语料库包含自动文摘功能、开放了对话机器人-知识图谱-语义理解-自然语言处理工具及数据、中文知识图谱:基于百度百科中文页面-抽取三元组信息-构建中文知识图谱、masr: 中文语音识别-提供预训练模型-高识别率、Python音频数据增广库、中文全词覆盖BERT及两份阅读理解数据、ConvLab:开源多域端到端对话系统平台、中文自然语言处理数据集、基于最新版本rasa搭建的对话系统、基于TensorFlow和BERT的管道式实体及关系抽取、一个小型的证券知识图谱/知识库、复盘所有NLP比赛的TOP方案、OpenCLaP:多领域开源中文预训练语言模型仓库、UER:基于不同语料+编码器+目标任务的中文预训练模型仓库、中文自然语言处理向量合集、基于金融-司法领域(兼有闲聊性质)的聊天机器人、g2pC:基于上下文的汉语读音自动标记模块、Zincbase 知识图谱构建工具包、诗歌质量评价/细粒度情感诗歌语料库、快速转化「中文数字」和「阿拉伯数字」、百度知道问答语料库、基于知识图谱的问答系统、jieba_fast 加速版的jieba、正则表达式教程、中文阅读理解数据集、基于BERT等最新语言模型的抽取式摘要提取、Python利用深度学习进行文本摘要的综合指南、知识图谱深度学习相关资料整理、维基大规模平行文本语料、StanfordNLP 0.2.0:纯Python版自然语言处理包、NeuralNLP-NeuralClassifier:腾讯开源深度学习文本分类工具、端到端的封闭域对话系统、中文命名实体识别:NeuroNER vs. BertNER、新闻事件线索抽取、2019年百度的三元组抽取比赛:“科学空间队”源码、基于依存句法的开放域文本知识三元组抽取和知识库构建、中文的GPT2训练代码、ML-NLP - 机器学习(Machine Learning)NLP面试中常考到的知识点和代码实现、nlp4han:中文自然语言处理工具集(断句/分词/词性标注/组块/句法分析/语义分析/NER/N元语法/HMM/代词消解/情感分析/拼写检查、XLM:Facebook的跨语言预训练语言模型、用基于BERT的微调和特征提取方法来进行知识图谱百度百科人物词条属性抽取、中文自然语言处理相关的开放任务-数据集-当前最佳结果、CoupletAI - 基于CNN+Bi-LSTM+Attention 的自动对对联系统、抽象知识图谱、MiningZhiDaoQACorpus - 580万百度知道问答数据挖掘项目、brat rapid annotation tool: 序列标注工具、大规模中文知识图谱数据:1.4亿实体、数据增强在机器翻译及其他nlp任务中的应用及效果、allennlp阅读理解:支持多种数据和模型、PDF表格数据提取工具 、 Graphbrain:AI开源软件库和科研工具,目的是促进自动意义提取和文本理解以及知识的探索和推断、简历自动筛选系统、基于命名实体识别的简历自动摘要、中文语言理解测评基准,包括代表性的数据集&基准模型&语料库&排行榜、树洞 OCR 文字识别 、从包含表格的扫描图片中识别表格和文字、语声迁移、Python口语自然语言处理工具集(英文)、 similarity:相似度计算工具包,java编写、海量中文预训练ALBERT模型 、Transformers 2.0 、基于大规模音频数据集Audioset的音频增强 、Poplar:网页版自然语言标注工具、图片文字去除,可用于漫画翻译 、186种语言的数字叫法库、Amazon发布基于知识的人-人开放领域对话数据集 、中文文本纠错模块代码、繁简体转换 、 Python实现的多种文本可读性评价指标、类似于人名/地名/组织机构名的命名体识别数据集 、东南大学《知识图谱》研究生课程(资料)、. 英文拼写检查库 、 wwsearch是企业微信后台自研的全文检索引擎、CHAMELEON:深度学习新闻推荐系统元架构 、 8篇论文梳理BERT相关模型进展与反思、DocSearch:免费文档搜索引擎、 LIDA:轻量交互式对话标注工具 、aili - the fastest in-memory index in the East 东半球最快并发索引 、知识图谱车音工作项目、自然语言生成资源大全 、中日韩分词库mecab的Python接口库、中文文本摘要/关键词提取、汉字字符特征提取器 (featurizer),提取汉字的特征(发音特征、字形特征)用做深度学习的特征、中文生成任务基准测评 、中文缩写数据集、中文任务基准测评 - 代表性的数据集-基准(预训练)模型-语料库-baseline-工具包-排行榜、PySS3:面向可解释AI的SS3文本分类器机器可视化工具 、中文NLP数据集列表、COPE - 格律诗编辑程序、doccano:基于网页的开源协同多语言文本标注工具 、PreNLP:自然语言预处理库、简单的简历解析器,用来从简历中提取关键信息、用于中文闲聊的GPT2模型:GPT2-chitchat、基于检索聊天机器人多轮响应选择相关资源列表(Leaderboards、Datasets、Papers)、(Colab)抽象文本摘要实现集锦(教程 、词语拼音数据、高效模糊搜索工具、NLP数据增广资源集、微软对话机器人框架 、 GitHub Typo Corpus:大规模GitHub多语言拼写错误/语法错误数据集、TextCluster:短文本聚类预处理模块 Short text cluster、面向语音识别的中文文本规范化、BLINK:最先进的实体链接库、BertPunc:基于BERT的最先进标点修复模型、Tokenizer:快速、可定制的文本词条化库、中文语言理解测评基准,包括代表性的数据集、基准(预训练)模型、语料库、排行榜、spaCy 医学文本挖掘与信息提取 、 NLP任务示例项目代码集、 python拼写检查库、chatbot-list - 行业内关于智能客服、聊天机器人的应用和架构、算法分享和介绍、语音质量评价指标(MOSNet, BSSEval, STOI, PESQ, SRMR)、 用138GB语料训练的法文RoBERTa预训练语言模型 、BERT-NER-Pytorch:三种不同模式的BERT中文NER实验、无道词典 - 有道词典的命令行版本,支持英汉互查和在线查询、2019年NLP亮点回顾、 Chinese medical dialogue data 中文医疗对话数据集 、最好的汉字数字(中文数字)-阿拉伯数字转换工具、 基于百科知识库的中文词语多词义/义项获取与特定句子词语语义消歧、awesome-nlp-sentiment-analysis - 情感分析、情绪原因识别、评价对象和评价词抽取、LineFlow:面向所有深度学习框架的NLP数据高效加载器、中文医学NLP公开资源整理 、MedQuAD:(英文)医学问答数据集、将自然语言数字串解析转换为整数和浮点数、Transfer Learning in Natural Language Processing (NLP) 、面向语音识别的中文/英文发音辞典、Tokenizers:注重性能与多功能性的最先进分词器、CLUENER 细粒度命名实体识别 Fine Grained Named Entity Recognition、 基于BERT的中文命名实体识别、中文谣言数据库、NLP数据集/基准任务大列表、nlp相关的一些论文及代码, 包括主题模型、词向量(Word Embedding)、命名实体识别(NER)、文本分类(Text Classificatin)、文本生成(Text Generation)、文本相似性(Text Similarity)计算等,涉及到各种与nlp相关的算法,基于keras和tensorflow 、Python文本挖掘/NLP实战示例、 Blackstone:面向非结构化法律文本的spaCy pipeline和NLP模型通过同义词替换实现文本“变脸” 、中文 预训练 ELECTREA 模型: 基于对抗学习 pretrain Chinese Model 、albert-chinese-ner - 用预训练语言模型ALBERT做中文NER 、基于GPT2的特定主题文本生成/文本增广、开源预训练语言模型合集、多语言句向量包、编码、标记和实现:一种可控高效的文本生成方法、 英文脏话大列表 、attnvis:GPT2、BERT等transformer语言模型注意力交互可视化、CoVoST:Facebook发布的多语种语音-文本翻译语料库,包括11种语言(法语、德语、荷兰语、俄语、西班牙语、意大利语、土耳其语、波斯语、瑞典语、蒙古语和中文)的语音、文字转录及英文译文、Jiagu自然语言处理工具 - 以BiLSTM等模型为基础,提供知识图谱关系抽取 中文分词 词性标注 命名实体识别 情感分析 新词发现 关键词 文本摘要 文本聚类等功能、用unet实现对文档表格的自动检测,表格重建、NLP事件提取文献资源列表 、 金融领域自然语言处理研究资源大列表、CLUEDatasetSearch - 中英文NLP数据集:搜索所有中文NLP数据集,附常用英文NLP数据集 、medical_NER - 中文医学知识图谱命名实体识别 、(哈佛)讲因果推理的免费书、知识图谱相关学习资料/数据集/工具资源大列表、Forte:灵活强大的自然语言处理pipeline工具集 、Python字符串相似性算法库、PyLaia:面向手写文档分析的深度学习工具包、TextFooler:针对文本分类/推理的对抗文本生成模块、Haystack:灵活、强大的可扩展问答(QA)框架、中文关键短语抽取工具

搜集、整理、发布 中文 自然语言处理 语料/数据集,与 有志之士 共同 促进 中文 自然语言处理 的 发展。

:herb: 中文近义词:聊天机器人,智能问答工具包

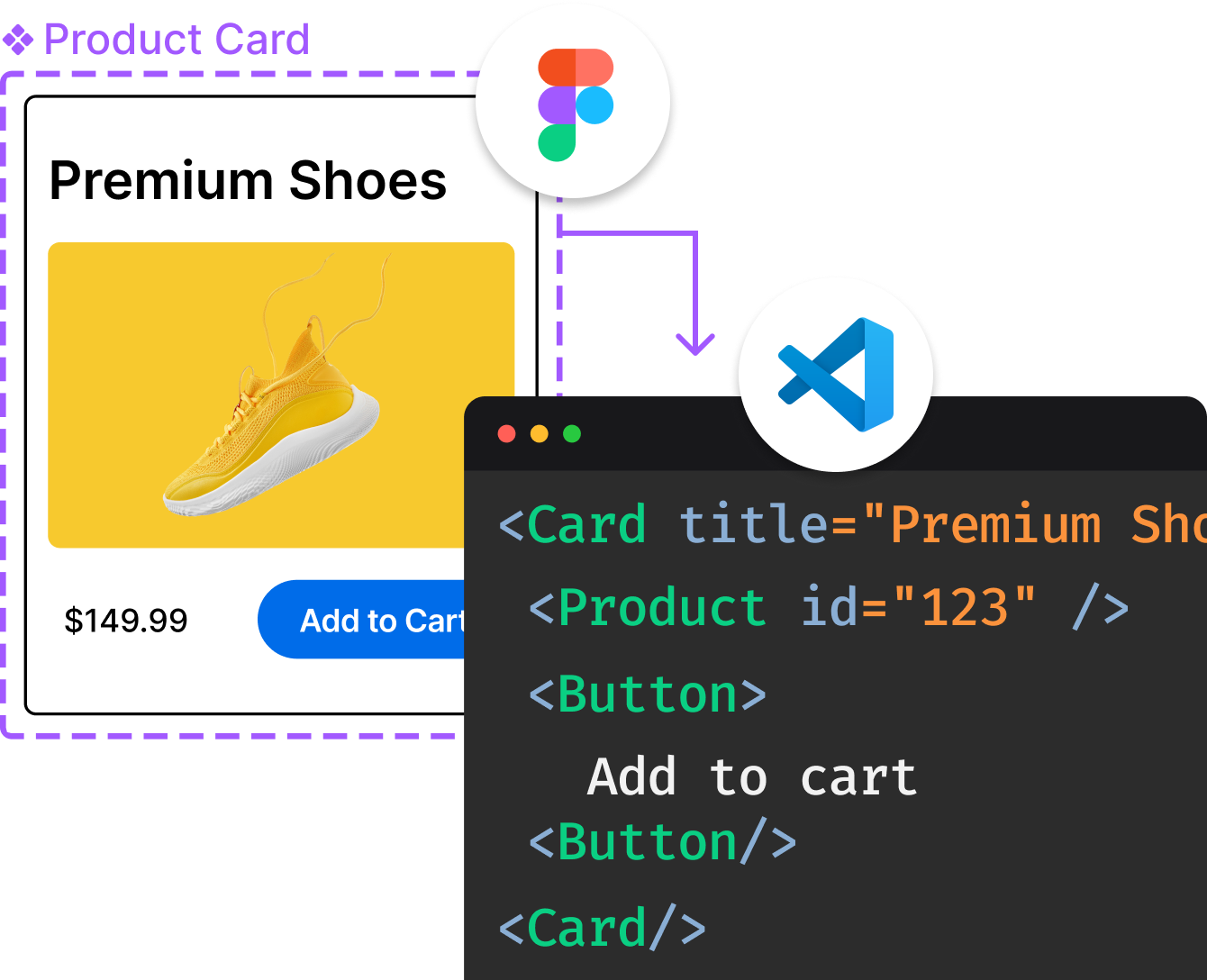

Convert  designs to code with AI

designs to code with AI

Introducing Visual Copilot: A new AI model to turn Figma designs to high quality code using your components.

Try Visual Copilot